I ricercatori hanno ideato un nuovo metodo per la correzione degli errori che ha permesso di raggiungere la più alta fedeltà mai registrata per qubit logici entangled su un processore quantistico superconduttore.

Un nuovo studio condotto da un team di ricercatori, tra cui IBM, ha trovato un modo per superare una sfida chiave nel campo del calcolo quantistico. (Crediti immagine: Flavio Coelho tramite Getty Images) Iscriviti alla nostra newsletter

I ricercatori hanno stabilito un nuovo record per la fedeltà dei qubit nei sistemi di computer quantistici superconduttori, superando una barriera fondamentale nel calcolo quantistico.

In uno studio pubblicato il 27 febbraio sulla rivista Nature Communications, scienziati di IBM, della RWTH Aachen University in Germania e della startup Quantum Elements con sede a Los Angeles hanno affrontato il problema della correzione e soppressione degli errori quantistici, che rappresenta l’ostacolo più significativo alla costruzione di macchine più potenti dei supercomputer più veloci.

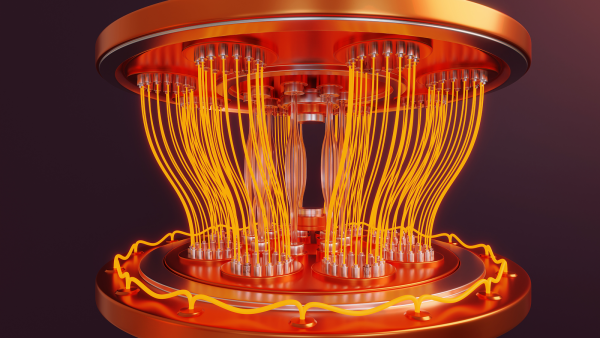

I computer quantistici superconduttori utilizzano i bit quantistici (qubit), l’equivalente quantistico di un bit di un computer, per eseguire calcoli. I sistemi impiegati dai ricercatori, i processori Kyiv e Marrakesh a 127 qubit di IBM, fanno uso di una combinazione di “qubit fisici” e “qubit logici”, ovvero gruppi di qubit fisici entangled che memorizzano la stessa informazione in luoghi differenti, nel caso in cui un qubit fisico che memorizza tale informazione fallisca durante il calcolo.

I qubit fisici sono integrati nello strato hardware di un computer quantistico sotto forma di un circuito complesso e geometricamente preciso realizzato in metallo superconduttore. Quando raffreddati quasi allo zero assoluto, questi metalli perdono ogni resistenza elettrica, permettendo all’informazione quantistica di fluire senza dissipazione di energia.

Tuttavia, questi qubit sono estremamente sensibili alla minima perturbazione, inclusi vibrazioni, rumore di fondo locale e altri fattori ambientali, rendendoli intrinsecamente fragili. Per compensare questa fragilità, gli scienziati raggruppano più qubit fisici per creare un qubit logico.

Quando i calcoli vengono eseguiti sui qubit logici, i qubit fisici agiscono come bit di parità che eliminano gli errori. Ma il problema intrinseco di questa configurazione, come evidenziato dagli scienziati nel nuovo studio, è la sua vulnerabilità agli “errori logici”.

Gli errori logici si verificano quando più qubit fisici all’interno di un qubit logico cedono al rumore. In sostanza, quando un qubit fisico fallisce, gli altri agiscono come un meccanismo di sicurezza contro il suo segnale errato. Ma quando più qubit falliscono simultaneamente, il sistema interpreta l’errore che producono come il segnale corretto, compromettendo il calcolo.

Sopprimere gli errori prima che si verifichino

I sistemi IBM a 127 qubit utilizzati dai ricercatori sono suscettibili a un tipo specifico di rumore denominato “diafonia ZZ” (ZZ crosstalk), generato dalla particolare disposizione dei loro qubit fisici.

Il team di Quantum Elements ha sviluppato un approccio ibrido per gestire questo specifico tipo di rumore. Esso prevede la soppressione degli errori di diafonia prima che si manifestino, riducendo così il numero complessivo di errori logici non rilevabili che possono verificarsi. Hanno combinato questa tecnica con gli strumenti esistenti di correzione degli errori per creare un innovativo protocollo ibrido.

Di conseguenza, i ricercatori hanno ottenuto i calcoli quantistici a più alta fedeltà — quelli con la minima quantità di rumore — su qubit superconduttori per il periodo di tempo più lungo mai registrato.

Secondo lo studio, in precedenza gli scienziati avevano raggiunto una fedeltà di codifica di picco del 79,5% in un tentativo e del 93,7% in un altro, che successivamente diminuiva a circa il 30% dopo circa 27 microsecondi.

La metrica di fedeltà di picco indica la massima accuratezza raggiunta all’interno del sistema quantistico, che si verifica immediatamente dopo la formazione del qubit logico. Più a lungo un computer quantistico riesce a mantenere una fedeltà di picco o quasi, maggiore è la sua capacità di eseguire algoritmi quantistici.

Il team ha superato questi precedenti record utilizzando una nuova tecnica chiamata “normalizer dynamical decoupling” (NDD). Hanno ottenuto una fedeltà di codifica di picco del 98,05%, che è rimasta all’84,87% dopo 55 microsecondi.

La parte refrigerata di un computer quantistico, dove i qubit vengono mantenuti a temperature prossime allo zero assoluto. (Crediti immagine: Dragon Claws/Getty Images)

Il “dynamical decoupling” convenzionale, una tecnica standard di correzione degli errori, prevede l’utilizzo di impulsi a microonde per indurre i qubit fisici a invertire il loro stato periodicamente. Questo serve a regolare i qubit e a mediare generalmente il rumore di fondo, ma lo fa agendo su un singolo qubit fisico alla volta.

Tuttavia, c’è un problema nell’ampliare questa tecnica: più qubit fisici sono presenti in un sistema, più impulsi a microonde sono necessari per sopprimere il rumore. Alla fine, ciò genera rumore aggiuntivo e introduce ancora più errori nel sistema, vanificando lo scopo, come spiegato dagli autori dello studio.

Gli scienziati hanno invece applicato questo paradigma al livello dei qubit logici, anziché eseguirlo strettamente a livello hardware. Per fare ciò, hanno dovuto inventare un metodo per regolare i suoi impulsi, utilizzando un “normalizzatore” matematico basato sul codice quantistico in esecuzione sulla macchina stessa. Questo ha permesso agli impulsi di operare in un ritmo correlato al codice della macchina.

Il risultato, il “normalizer dynamical decoupling”, ha prodotto finora i calcoli a più alta fedeltà su un computer quantistico superconduttore. Più a lungo questo livello di alta fedeltà può essere mantenuto, più utili ci si può aspettare che diventino i computer quantistici.

Il numero di porte quantistiche — o operazioni quantistiche singole — che un sistema quantistico può eseguire dipende da quanto tempo è in grado di mantenere la fedeltà quantistica. Tipicamente, per eseguire una singola porta sono necessari dai 10 ai 12 nanosecondi. Ciò significa che potrebbero verificarsi circa da 4.500 a 5.500 operazioni consecutive nei 55 microsecondi prima che i dati si degradino, come dimostrato in questo studio.

L’obiettivo finale del calcolo quantistico è creare un dispositivo in grado di operare ad alta fedeltà per un tempo sufficiente a eseguire operazioni veramente utili, come l’esecuzione dell’algoritmo di Shor per decifrare la crittografia. Si stima che funzioni avanzate come queste potrebbero un giorno richiedere settimane o mesi per essere completate correttamente da un sistema quantistico capace — il che non è poi così male se si considera che un computer classico impiegherebbe centinaia di trilioni di anni per ottenere lo stesso risultato.

I 55 microsecondi di attività ad alta fedeltà, che battono ogni record, sembrano lontani dal raggiungere l’utilità pratica, ma rappresentano un balzo significativo rispetto agli sforzi precedenti.

Pensi di sapere tutto sui computer? Metti alla prova le tue conoscenze con il nostro quiz sui computer!

Sourse: www.livescience.com